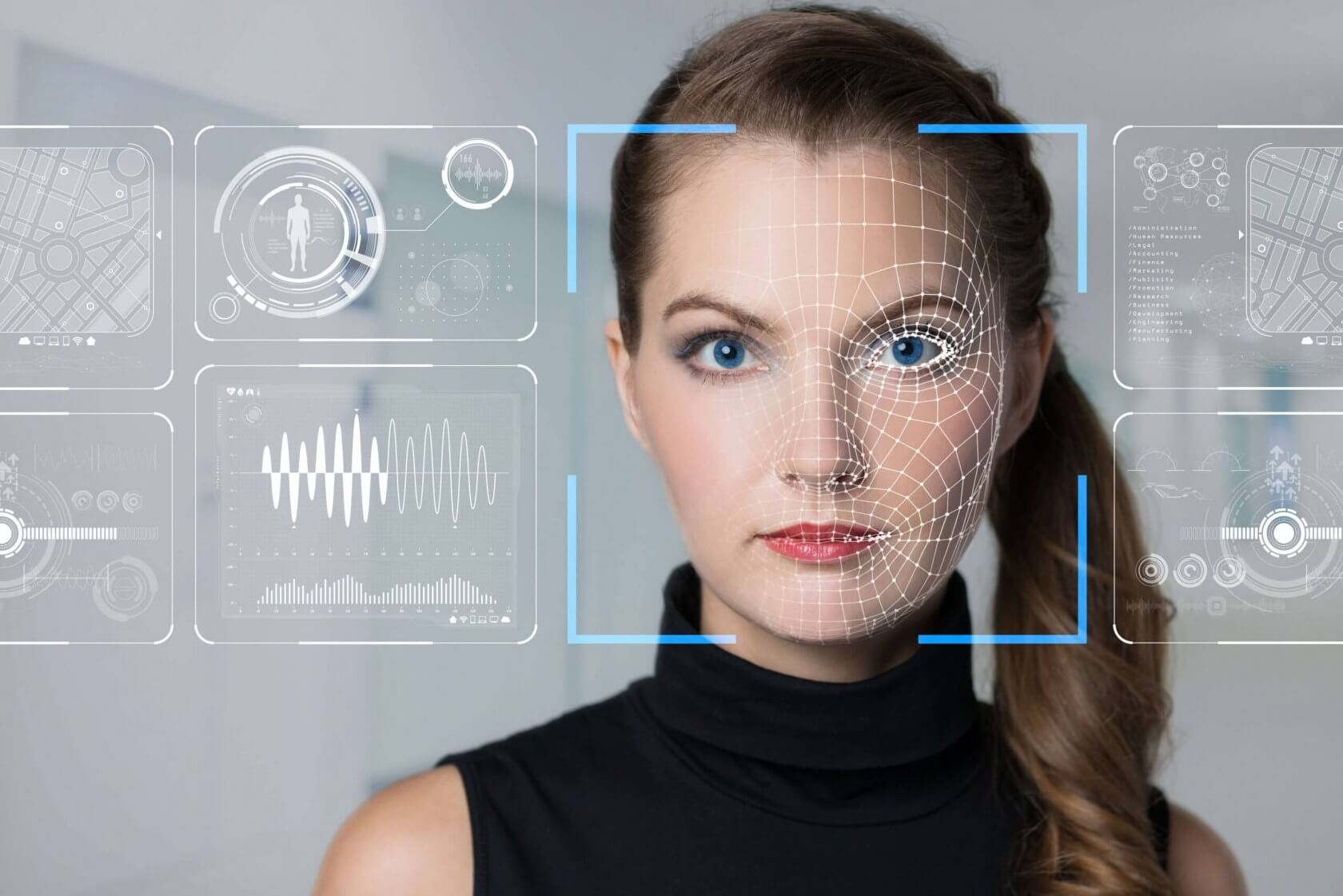

Compañía de reconocimiento facial podría acabar con tu privacidad

Cientos de agencias en Estados Unidos están utilizando un sistema que busca a posibles sospechosos, utilizando la tecnología reconocimiento facial, a partir de miles de millones de fotos eliminadas de Internet.

Cientos de agencias de aplicación de la ley en Estados Unidos han comenzado a utilizar un nuevo sistema de reconocimiento facial de la compañía Clearview AI, así lo reveló una nueva investigación realizada por el diario The New York Times.

La base de datos está compuesta por miles de millones de imágenes extraídas de millones de sitios, incluidos Facebook, YouTube y Venmo. El rotativo señaló que el trabajo de Clearview AI podría "terminar con la privacidad tal como la conocemos", y vale la pena leer la pieza en su totalidad.

El uso de sistemas de reconocimiento facial por parte de la policía ya es una preocupación creciente, pero la escala de la base de datos de Clearview AI, sin mencionar los métodos que usó para ensamblarla, es particularmente preocupante.

El sistema Clearview se basa en una base de datos de más de tres mil millones de imágenes eliminadas de Internet, un proceso que puede haber violado los términos de servicio de los sitios web. Los organismos encargados de hacer cumplir la ley pueden subir fotos de cualquier persona de interés de sus casos, y el sistema devuelve imágenes coincidentes de Internet, junto con enlaces a donde se alojan estas imágenes, como los perfiles de redes sociales.

The New York Times, indicó que el sistema ya ha ayudado a la policía a resolver crímenes que incluyen robos en tiendas, identificación de robos, fraudes con tarjetas de crédito, asesinatos y explotación sexual infantil. En un caso, la Policía del Estado de Indiana pudo resolver un caso en 20 minutos utilizando la aplicación.

No obstante, el uso de algoritmos de reconocimiento facial por parte de la policía conlleva riesgos. Los falsos positivos pueden incriminar a las personas equivocadas, y los defensores de la privacidad temen que su uso pueda ayudar a crear un estado de vigilancia policial.

Según los informes, los departamentos de policía han utilizado imágenes manipuladas que podrían conducir a arrestos injustos, y un estudio federal ha descubierto "evidencia empírica" de sesgo en los sistemas de reconocimiento facial.

De igual manera ,la utilización del sistema implica subir fotos a los servidores de Clearview AI, y aún no está claro, qué tan seguros son. Aunque Clearview AI señaló que sus empleados de atención al cliente no ven las fotos que se cargan, parece ser consciente de que Kashmir Hill (la periodista del Times que investiga el artículo) estaba haciendo que la policía buscara su rostro como parte de su informe:

"Mientras la compañía me esquivaba, también me estaba monitoreando. A petición mía, varios agentes de policía pasaron mi foto a través de la aplicación Clearview. Pronto recibieron llamadas telefónicas de representantes de la compañía preguntando si estaban hablando con los medios, una señal de que Clearview tiene la capacidad y, en este caso, el apetito de controlar a quién busca la policía".

The Times informó que el sistema parece haberse vuelto viral en los departamentos de policía, con más de 600 ya registrados. Aunque no ha habido una verificación independiente de su precisión, Hill indicó que el sistema pudo identificar fotos de ella incluso cuando cubrió la mitad inferior de su rostro, y que logró encontrar fotografías de ella que nunca antes había visto.

Un experto citado por The Times dijo que la cantidad de dinero involucrado con estos sistemas significa que deben ser prohibidos antes de que el abuso de ellos se generalice. "Hemos confiado en los esfuerzos de la industria para auto-policía y no adoptar una tecnología tan arriesgada, pero ahora esas represas se están rompiendo porque hay mucho dinero sobre la mesa", dijo un profesor de derecho y ciencias de la computación en la Northeastern University, Woodrow. Hartzog, “No veo un futuro en el que aprovechemos los beneficios de la tecnología de reconocimiento facial sin el abrumador abuso de la vigilancia que conlleva. La única forma de detenerlo es prohibiéndolo".